動物行為的觀察實驗,是一項需要極度耐心與時間的工作。為此,目前已有許多運用AI的行為解析工具問世,動物行為解析的效率得到了飛速提升。然而,這類工具大多通過追蹤骨骼等資訊來推斷行為,一旦畫面裏的動物相互重疊等、部分身體被遮擋,解析的精度及速度就會大幅下降。

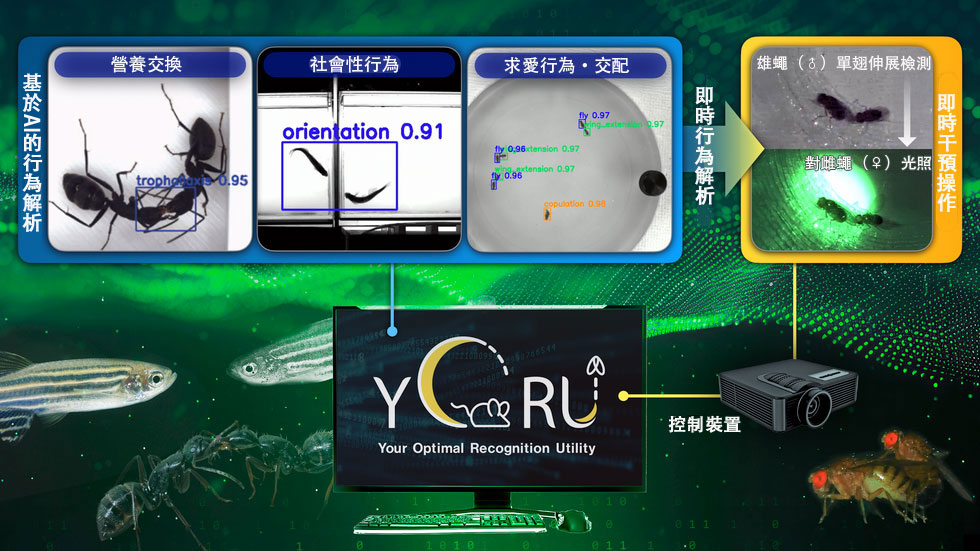

AI工具「YORU」概要(供圖:名古屋大學)

左:名古屋大學研究生院理學研究科山之內勇鬥博士生;右:該校上川內梓教授(供圖:名古屋大學)

名古屋大學研究生院理學研究科博士生山之內勇鬥、田中良彌講師、上川內梓教授,與該校研究生院創藥科學研究科的竹內遼介助教等人組成的研究團隊,開發出了一款可直接解析動物展現特定行為時的姿態、外觀與形態特徵的AI動物行為解析工具「YORU」。上川內教授表示:「哪怕是複雜的行為,只要人眼能夠分辨,系統就能學習並完成解析。我們已把這款工具以開源形式免費公開(https://kamikouchi-lab.github.io/YORU_doc/),希望供廣大科研人員使用。」該研究成果已發表在期刊《Science Advances》上。

要研究動物行為的內在機制,就必須對各類行為進行單獨的解析與量化。YORU應用了機器學習演算法中的一類——目標檢測技術,不僅可完成既往工具難以實現的、伴有複雜動作的交配、理毛等行為的解析,還實現了對多個體同時發生相互作用的社會性行為的精準、快速解析。此外,通過即時解析功能與投影光學系的結合,該系統可精準靶向鎖定展現出特定行為的個體,並成功實現了對其神經活動的操控。

山之內博士生表示:「只需從視頻裏選定要解析的行為,截取幾十到數百幀包含該行為的畫面進行訓練,系統就能識別對應行為。哪怕動物相互重疊,只要人眼能憑外觀分辨清楚,系統就能以90%以上的精度完成區分。」

實驗中,該系統成功實現了對8隻果蠅的求愛與交配行為、6隻螞蟻的營養交換行為,以及斑馬魚定向行為的高精度檢測。同時,研究團隊還利用光遺傳學技術,開展了果蠅神經活動操控實驗。

果蠅的單翅伸展,是雄蠅求愛時展開並振動單側翅膀的行為。雌蠅聽到由該動作產生的、被稱為「求愛歌」的聲音後,交配接受度會提升。由此,研究團隊開展了一項即時檢測雄蠅的單翅伸展行為,並在動作發生的瞬間通過光遺傳學手段對控制翅膀伸展的神經元活動進行抑制的實驗。

研究團隊通過YORU對相機拍攝的畫面幀進行即時解析,並根據翅膀伸展的檢測結果控制光照——雄蠅伸展翅膀後立即照射光線,由此觀察到雄蠅翅膀伸展的頻率隨神經元的抑制而下降,並確認其交配率也同步降低。由此表明,求愛歌被抑制會引發交配行為的抑制。

此外,為了在多個體共存的場景中,實現對應每個個體行為的個體選擇性光刺激,研究團隊還集成了投影機光源控制模組。使用該模組,團隊開展了一項在檢測到雄性單翅伸展的瞬間,對雌性施加聚光燈式光照的實驗。實驗中使用的是經基因操作,可通過光照抑制其初級聽覺神經元的雌蠅。其結果顯示,系統成功實現了依據雄性單翅伸展行為對雌性進行選擇性光照,使其交配率下降。

由此,研究團隊證實了通過運用YORU,可在檢測到特定行為的瞬間對特定個體的神經活動進行操控。

山之內博士生表示:「直到兩年前,我仍在嘗試用現有方法做行為解析,但進展不順利,於是轉變了解析思路,不再基於骨骼,而是從外觀入手。我以日語‘夜(yoru)’為靈感,將工具命名為YORU,取其可在夜間自動完成解析的寓意。該工具可大幅降低觀察工作的負擔,期待其能被應用於社會性行為等相關研究領域。」

原文:《科學新聞》

翻譯:JST客觀日本編輯部

【論文資訊】

期刊:Science Advances

論文:YORU: animal behavior detection with object-based

approach for real-time closed-loop feedback

DOI:10.1126/sciadv.adw2109