美國Alphabet旗下的英國Google DeepMind以及企業家埃隆·馬斯克領導的美國特士拉正致力於開發類人機器人。其中的關鍵是生成式AI(人工智慧)。AI的出現加速了超越特定作業的機器人的開發。本報就研究前景採訪了專門研究機器學習和機器人工學的早稻田大學尾形哲也教授。

早稻田大學尾形哲也教授:1993年畢業於早稻田大學理工學部。2005年擔任京都大學研究生院資訊學研究科副教授,2012年起擔任早稻田大學理工學術院教授。2020年起擔任早稻田大學新一代機器人研究機構AI機器人研究所所長。

——您如何看待生成式AI和機器人研究的現狀。

「隨著大規模語言模型(LLM)的出現,機器人幾乎可以完成所有能用語言指示的工作。也可以自動編寫程序。但是,機器人無法完成像繫鞋帶、做炒蛋等不能僅靠文字就能簡單說明的工作。」

「我們需要的是通過身體運動獲得的經驗數據。以使用(機器人的)身體的作業數據為基礎進行學習很重要。因為摺紙和烹飪不能簡單地解釋,所以機器人也不知道該怎麼操作。我們已經進入了一個試圖揭開無法直接用物理可用能方程式解開其現象的階段。」

——如何收集這些身體數據並讓機器人學習呢?

「這是一個重點。現在是讓機器人通過反復摺疊洗好的衣物等特定的作業來學習。事實上,我們希望有一種方法可以整合這些經驗數據,讓機器人更容易掌握。但目前還沒有通用可行的方法。」

「人類是處理未知任務能力異常強的生物。例如,開啟一扇門有許多不同的方法,但如果你知道幾種開門的模式,你就可以猜到並開啟它。這對機器人來說很難。隨著越來越多的對看似普通的任務的研究出現,我們可能會逐漸看到AI無法學習的侷限性。」

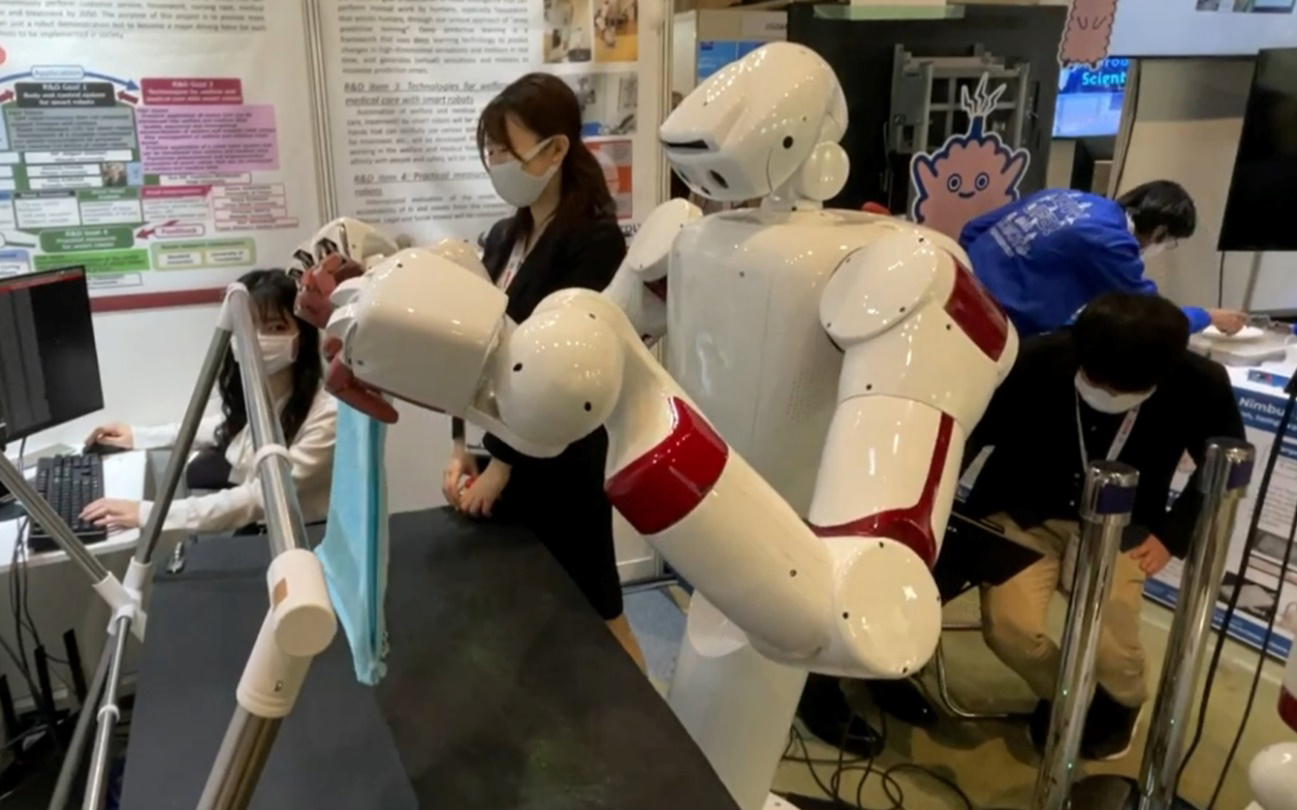

早稻田大學展示的機器人掛毛巾作業示範(2022年)

——機器人學習的關鍵點是什麼?

「是觸覺。大多數人認為可以通過圖像模型或LLM來進行控制,但是在人類實際操作時更多的是依靠手的觸覺。即使是拉開或關閉拉鍊,當意識到卡住時人類也能判斷應該向哪個方向施力。如果收集觸覺資訊並讓AI學習,現有的機器人的表現也有可能超出預期。在企業界,特士拉正在採取這樣的方法。」

「關鍵詞是‘共同演化’。我們以往的工作是為工業用機器人開發人工智慧,但現在恰恰相反。如果可以用AI來控制機器人,那麼就要為它添加機器人功能。增加圖像和觸覺,使其成為多模態機器人。這樣一來,又要求AI必須是多模態化的。這樣反過來又可以提高機器人的功能,例如增加手指和手臂的數量等。」

日文:前田悠太、《日經產業新聞》、2024/3/25

中文:JST客觀日本編輯部