大阪大學研究生院基礎工學研究科的山田真由研究生、大橋Hiro乃特任研究員、細田耕教授和志垣俊介助教,與東京工業大學工學院系統控制系的倉林大輔教授組成的研究團隊全球首次證實,昆蟲有效搜尋氣味來源需要整合多個感官的資訊。

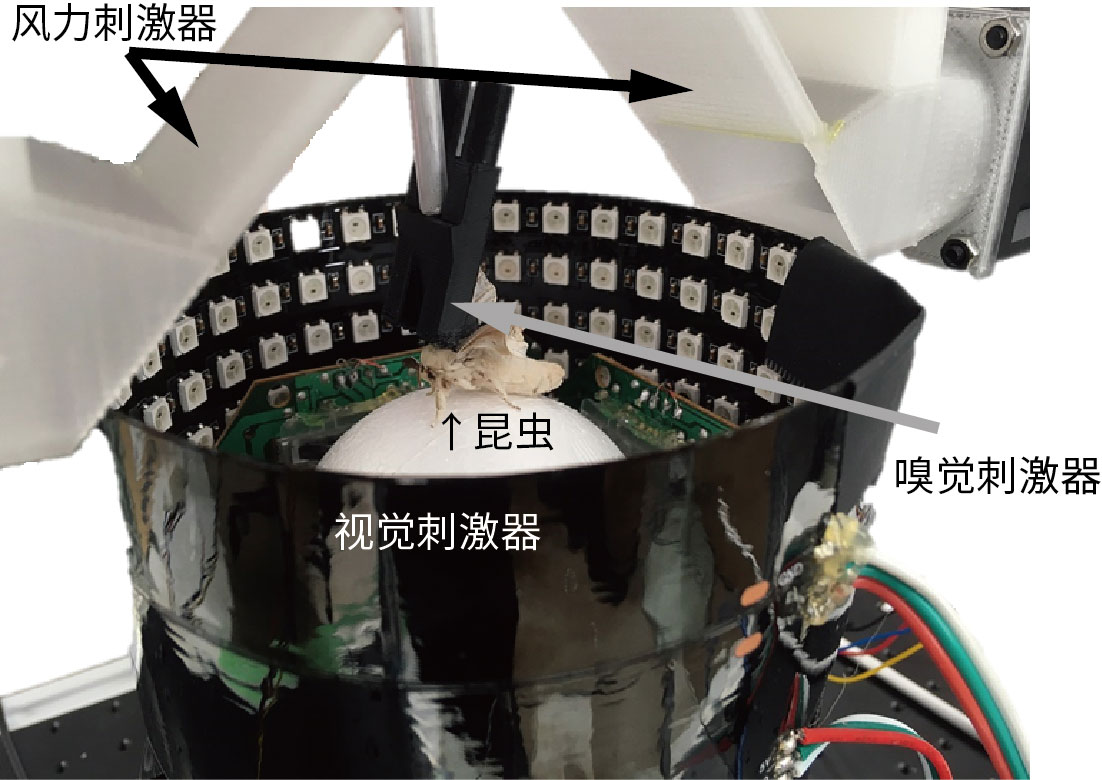

大阪大學研究團隊開發的昆蟲分析氣味來源搜尋行為的VR裝置(供圖:大阪大學)

儘管對生物的卓越適應能力進行人工化的研究有很多,但目前尚未開發出一個能在所有環境中都能表現出像生物一樣的機器人。其原因是,我們尚未明確生物暴露於各種環境時從環境中接收了什麼樣的資訊並將其反映到了行為中。

研究團隊通過將虛擬實境技術應用於昆蟲,為其營造了一種宛如在真實環境中移動的錯覺,並獲得了逐漸改變呈現給昆蟲的環境時的行為變化關係。為了闡明昆蟲的適應力氣味來源搜尋行為,研究團隊構建了可以同時連續呈現多種環境信息(氣味、風、光)的昆蟲VR系統。

另外,還利用昆蟲VR系統調查了,雄家蠶尋找雌家蠶時是如何整合資訊的。通過生物學分析發現,氣味和風的資訊有助於調整爬行和旋轉的速度,視覺資訊有助於控制姿勢。此外,還根據生物學數據構建了模型,並通過模擬評估了功能。結果表明,該模型比過去構建的氣味來源搜尋模型具有更高的搜尋成功率,而且搜尋軌跡也與化石相同。

志垣助教表示:「昆蟲會根據感官刺激的細微差異改變自己的行為,因此,為了給昆蟲營造宛若在真實環境中爬行一樣的錯覺,確定感官刺激的強度和速度時大費周章。今後將根據通過昆蟲VR獲得的生物實驗數據構建操作機器人的模型,並將其實現為,即使在惡劣的環境下也能完成任務的機器人系統。」

原文:《科學新聞》

翻譯編輯:JST客觀日本編輯部