東京大學研究生院藥學系研究科的山城皓太郎(博士生)和池谷裕二教授等人的研究團隊發表研究成果稱,通過記錄大鼠(老鼠)大腦皮層的局部場電位,構建了一個基於神經活動的人工智慧圖像生成系統。該系統利用一種可以從噪音生成圖像的生成式AI——「潛在擴散模型」,並將神經活動作為噪音成分使用。通過更改模型,圖像類型還可以自由設置。這是全球首次將腦活動與人工智慧相結合進行繪畫的系統。相關研究成果已於9月7日發表在國際學術期刊《PLOS ONE》上。

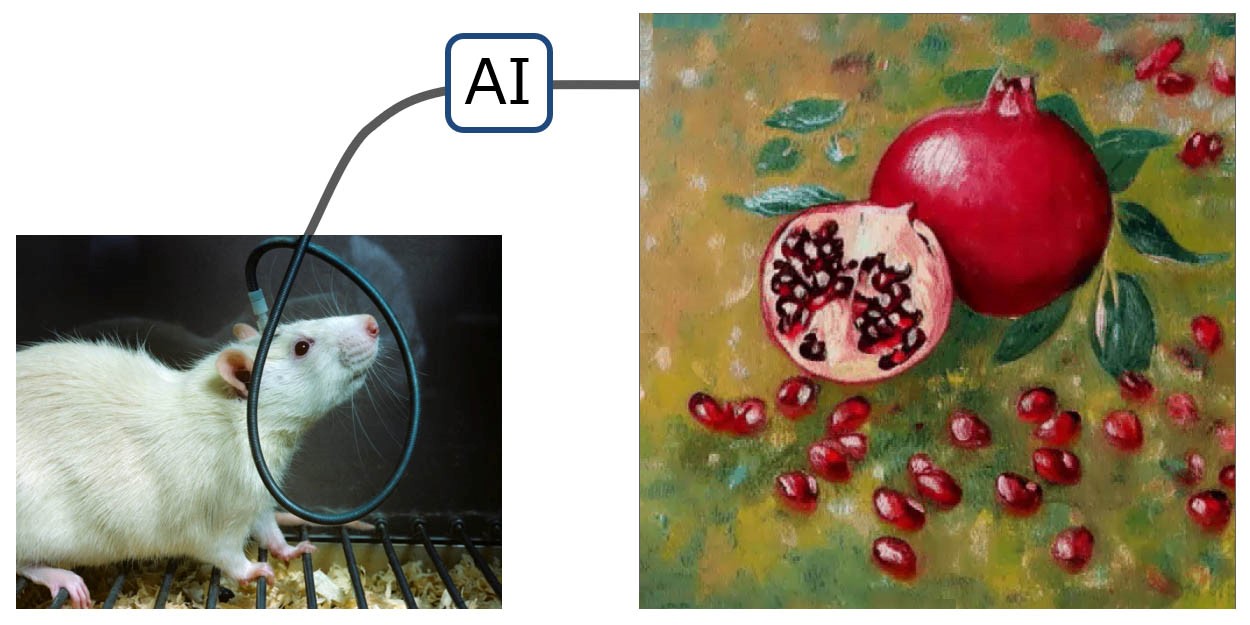

圖 根據老鼠大腦皮層的神經活動即時生成圖像(供圖:東京大學)

「Stable Diffusion」是Stability AI公司於2022年8月發布的一款開源模型,客戶隻需輸入例如「騎馬的宇航員」的本文資訊即可輸出相應圖像。與此前公佈的基於文字生成圖像的服務模型不同,該模型開源,客戶可以自由定製模型。

研究團隊構建了一個框架,使系統能夠直接將大鼠大腦皮層記錄的局部場電位即時輸入到Stable Diffusion模型中。

擴散模型通過學習如何去除圖像中的噪音並恢復出原始圖片,從而具備了從純噪音中複原圖像的能力。在訓練過程中,擴散模型學習了一組預定圖像的特徵,通過向該模型輸入高斯噪音等隨機噪音,即可生成符合所學習的圖像風格的全新圖像。

在「Stable Diffusion」這類基於本文生成圖像的模型中,通過將輸入的本文作為從噪音恢復圖像的參考依據,即可根據本文來生成圖像。此類模型接受噪音和文字指令兩種輸入,並根據文字生成對應的圖像。同時,如果故意不輸入文字指令,模型也可以僅依靠噪音生成圖像。

在此次開發的系統中,研究人員未輸入任何文字指令,而是將記錄的大鼠大腦皮層的局部場電位作為生成圖像的噪音輸入。局部場電位記錄了神經元發出的信號,是一種波形的時間序列數據,但這種資料格式無法直接輸入模型,因此需要進行壓縮以符合模型的要求。

研究團隊預計,如果能夠將大鼠的内部狀態反映在生成的圖像中,未來就有可能實現根據大鼠的「情緒」生成圖像。例如,當大鼠感興趣時,可能生成明亮氛圍的圖像;而在大鼠感到睏倦時,則可能生成寧靜氛圍的圖像。

研究團隊表示,此次開發的方法從原理上講,不僅可以應用於神經活動,還可以應用於心髒、腸蠕動等多種生物信號,甚至可以擴展到風、海浪等自然現象的時序信號。

池谷教授表示:「將老鼠大腦活動應用於生成繪畫的嘗試,看似離奇,但這項研究不僅揭示了圖像生成式AI的新的可能性,也大大拓展了藝術表現領域,是一項創新性嘗試。展望未來,我們還考慮將此項技術應用於人類的生物信號。」

原文:《科學新聞》

翻譯:JST客觀日本編輯部

【論文資訊】

期刊:PLOS ONE

論文:Diffusion model-based image generation from rat brain activity

DOI:10.1371/journal.pone.0309709