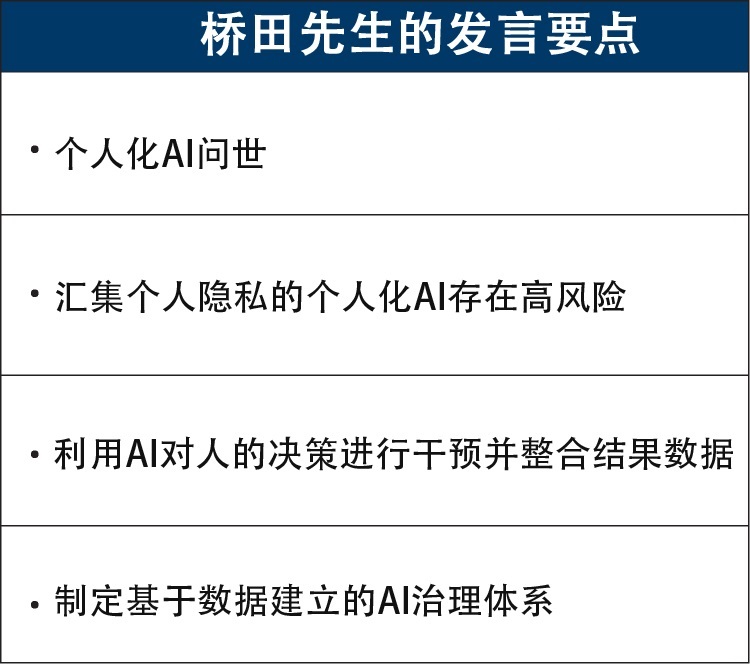

人工智慧(AI)和自然語言處理領域的東京大學橋田浩一教授預測,不久的將來,面向個人的AI服務將會面世。這種個人化AI可以集中管理商品的購買記錄、活動記錄、健康診斷結果等資訊,然後根據個人的喜好和需求提供相應的商品和服務。橋田浩一教授指出這類服務的風險管理愈加重要,需要制定新的規則。

東京大學研究生院資訊理工學研究科橋田浩一教授

——大語言模型(LLM)的生成式AI正在不斷融入人們的生活。

「個人化AI服務終將出現。各種服務和内容被整合到一起,AI將成為個人資訊門戶。美國微軟的聯合創始人比爾·蓋茨等人也表達過同樣的觀點。將可以整合知識的AI進行個性化定製是必然的結果。」

「例如,亞馬遜日本(東京目黑區)提供了名為‘亞馬遜安心郵件'的服務。如果在亞馬遜購買尿布和蜂蜜,就會收到一封提醒您‘不要給不滿一歲的嬰兒喂蜂蜜'的電郵。如果沒有同時購買這兩樣商品,就不會發送此郵件。」

「如果個人化AI能夠完全掌握客戶的購買歷史,這是完全可以做到的。嘗試向ChatGPT諮詢也會得到同樣的回答。」

——更加便利的同時,也可能伴隨著更高的風險。

「個人專屬的AI將會訪問並利用比以往更龐大且敏感的個人數據來為客戶提供服務。如果能保證個人的秘密和隱私絕對不會洩漏,並得到客戶足夠信任,才能把一切都委託給AI。」

「相反,充分利用個人數據也意味著,如果程序存在漏洞或學習數據存在偏差,風險將會增加。提供AI服務的企業也需要管理這種風險。」

——目前對AI監管的討論是否不夠?

「歐盟(EU)採取了基於風險的方法對AI進行監管,但幾乎無法預測AI的具體風險。分析AI服務對個人造成了什麼影響,需要同時考慮AI對客戶決策的干預以及其結果的數據。目前提倡第三方能夠分析其利弊的‘擴展數據可攜性'」。

——這是否意味著需要建立基於數據而非事先規定的第三方驗證機制?

「需要分析數據,來靈活檢測各種風險。也可以用於AI的審查和服務改進。因此,需要制定相關法律法規。國際標準組織(ISO)已經成立了一個專門委員會,負責相關專業術語的標準化以及與AI相關的標準化,並開始討論這些問題。我們希望這能對各國的規則制定產生一定的約束影響。」

商業化和客戶視角

比爾·蓋茨正在與微軟合作的項目之一是「個人助理」。它在個人設備上運行,存儲一切資訊,並幫助選擇需要關注的事物和注意點。

個人化AI是商業化AI的一種方式。但是,如果過於看重AI提供商的利益,而不是客戶的利益,可能會引發問題。橋田先生指出,為了分析AI對個人的影響,需要同時收集來自AI的干預客戶決策的數據以及其結果的數據。

產生巨大影響的生成式AI正在推動企業的研發。客戶需要在認識到負面影響的前提下探索其應用方法。

日文:大豆生田崇志、《日經產業新聞》、2023/8/28

中文:JST客觀日本編輯部